Académie

Découvrez ces petits robots qui parcourent le web à la recherche d’information. Comprendre les crawlers, c’est comprendre la base du SEO.

Comment fonctionne le crawler?

Imaginé l’internet comme une grande toile d’araignée sur laquelle le dieu Google lancerait une armés d’araignées robotiques (d’où les noms Web et Spider) afin d’y découvrir tous les sites qui si trouves.

Après avoir analysé et enregistré le contenu de chaque page découverte, les crawlers rapportent leur information à Google qui lui la transcrit dans un grand livre appelé, index.

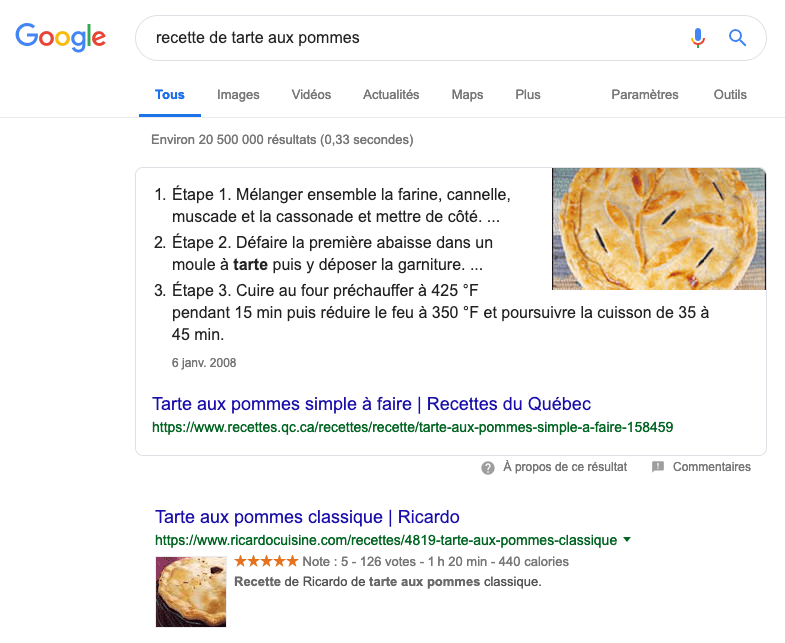

Lorsque vous faites une recherche sur Google, ce n’est pas l’internet que vous recherchez, mais bien l’index de Google. Si vous recherchez le mot clé « recette de tarte aux pommes », Google vous indiquera qu’il a découvert 20 500 000 pages dans son index qui mentionnent « recette de tarte aux pommes », et ce en fouillant durant 0,33 seconde… Impressionnant.

Que fait Google avec les informations que lui rapportent ses Googlebots?

L’information des spiders est emmagasinée dans la mémoire de Google et utilisée afin de fournir les pages de résultats du moteur de recherche, communément appelé SERP, pour « Search engine result page ». Ce sont ces résultats que nous présente Google en grosses lettres bleues lors d’une recherche.

Bien sûr, l’algorithme de Google est extrêmement complexe, mais dans sa forme la plus simple, Google n’est en réalité qu’un programme de détection de modèles. Lorsque vous recherchez un mot clé (c’est comme ça qu’on appelle le ou les mots que vous utilisez pour faire votre recherche), Google vous fournira une liste de sites Web correspondant au modèle associé à votre recherche.

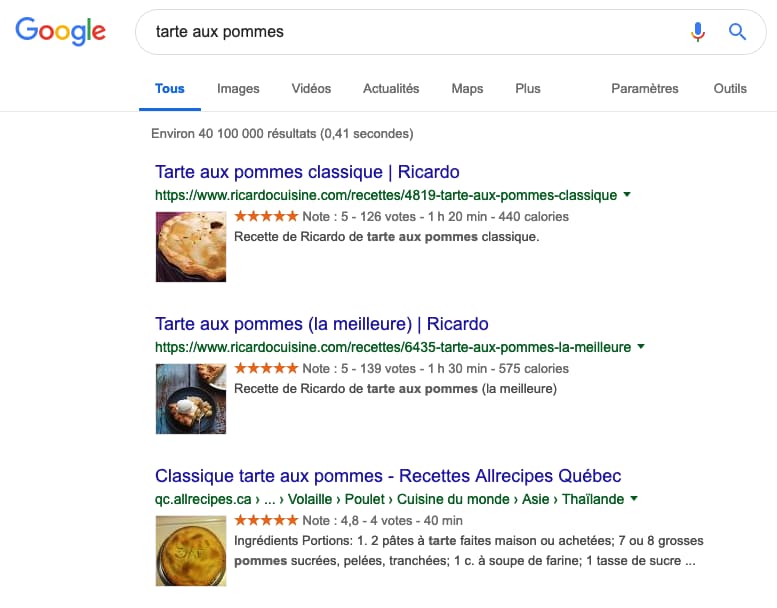

Donc si dans ma recherche de tarte, j’avais inscrit, « Tarte aux pommes » au lieu de « Recette de tarte aux pommes » comme mot clé, le résultat aurait été semblable, mais légèrement différent, et ce p.c.q. Google n’aurait pas utilisé le même mot clé pour faire sa recherche. Donc le modèle, c.-à-d. les lettres du mot clé que j’ai recherché, était différent et comportait un caractère plus générique.

En plus de toutes les recettes de tarte aux pommes, Google me proposera aussi une multitude d’autres pages qui parleront entre autres de parfum à l’odeur de tarte aux pommes, d’histoires qui mentionnent les mots tarte aux pommes, d’images nommées tarte aux pommes ou bien d’un simple blogue qui nous parle de crawlers…

On voit que pour la nouvelle recherche, comme on doit s’y attendre, le nombre de pages proposées passe de 20,5 millions à 40,1 millions et que Google a soustrait la recette du début.

La majorité des gens ne se rendent pas compte que lorsqu’ils effectuent une recherche sur Google, ils ne recherchent pas réellement le Web. En fait, ils recherchent l’index Web de Google… la copie stockée des sites que Google a explorés. Les Googlebots sont l’outil utilisé par Google pour découvrir le contenu des sites du Web. Fondamentalement, un spider va commencer sur une page et extraire tout le contenu de cette page, puis il suit les liens vers d’autres pages qui s’y rattachent. Ensuite, il suit de nouveau les liens sur ces pages pour découvrir encore plus de contenu, et ainsi de suite… Les spiders continuent de voyager à une vitesse ahurissante jusqu’à ce que la plupart des sites Internet aient été explorés. Notez qu’on compte aujourd’hui plus de 30 billions de pages Web indexés par Google…Au fur et à mesure que les spiders explorent toutes ces pages, une copie est stockée sur les serveurs de Google. C’est ici que le classement entre en jeu — et c’est ici que le travail de SEO commence. Google utilise un algorithme pour consulter la liste de pages extraite de l’index et pour classer les pages en fonction de leur pertinence.Dans notre recherche « Recette de tarte aux pommes » — Google a cherché dans l’index et créé une liste de tous les sites Web avec une recette de tarte aux pommes. Ensuite, il a utilisé son algorithme pour trier cette liste afin que les sites les plus pertinents se trouvent en haut de la liste. (Bravo Ricardo !)

Quelles sont les limitations de l’index de Google?

L’index de Google ne détectera que les pages que nous voulons bien lui montrer. Si le programmeur d’un site ne veut pas que Google indexe certaines pages de son site, il n’aura qu’à l’indiquer avec le terme no-index dans son code. Aussi, si par erreur vous créer un page Web qui n’est pas relié à votre site, ce qu’on appelle dans le jargon une page orpheline, les crawlers ne disposeront pas du « fil » de la toile qui les mènera sur la page, celle-ci risquera alors d’être ignorer par Google. Un site bien fait est un site ou toutes les pages sont reliées entre elles.

Finalement, la plus importante limitation de l’index de Google, c’est le temps entre chacune des indexations pour les sites qui s’y trouvent. Disons que je fais un changement sur cette page et qu’au lieu de tarte aux pommes, je décide de me servir du mot clé « gâteau aux bananes » dans mes exemples. Et bien, jusqu’à ce que les Googlebots me rendent une nouvelle visite, je continuerai d’apparaître dans l’index lors de la recherche sur tarte aux pommes. Pire encore si je décidais d’effacer cette page et de la remplacer par une URL différente, les internautes pourraient tout de même s’y rendre, mais il ferait face au code 404, page non trouvée.

Il existe des centaines de facteurs de classement dans l’algorithme de Google, chacun ayant un poids ou une valeur attribuée différents. L’algorithme examine quelques centaines de facteurs qui influencent le rang qui sera attribué à la page (sa pertinence), tel son contenu, le nombre d’autres sites ayant un lien vers cette page et la qualité du site Web.

Lorsque nous faisons du référencement, nous tentons d’influencer ces scores de pertinence. Nous savons que si nous optimisons les bons signaux, l’algorithme de Google décidera que la page est des plus pertinente — et qu’elle est une des meilleures réponses à la question posée — et Google affichera cette page plus haut dans le SERP.

Découvrez comment influencer la position des pages d’un site Web dans l’index Google sur notre page SEO Académie.

N’hésitez pas à communiquer avec moi pour toutes questions.

Eric St-Cyr

Leader ProStarSEO

[email protected]

581 447 4376

Chez Prostar SEO, On parle Google